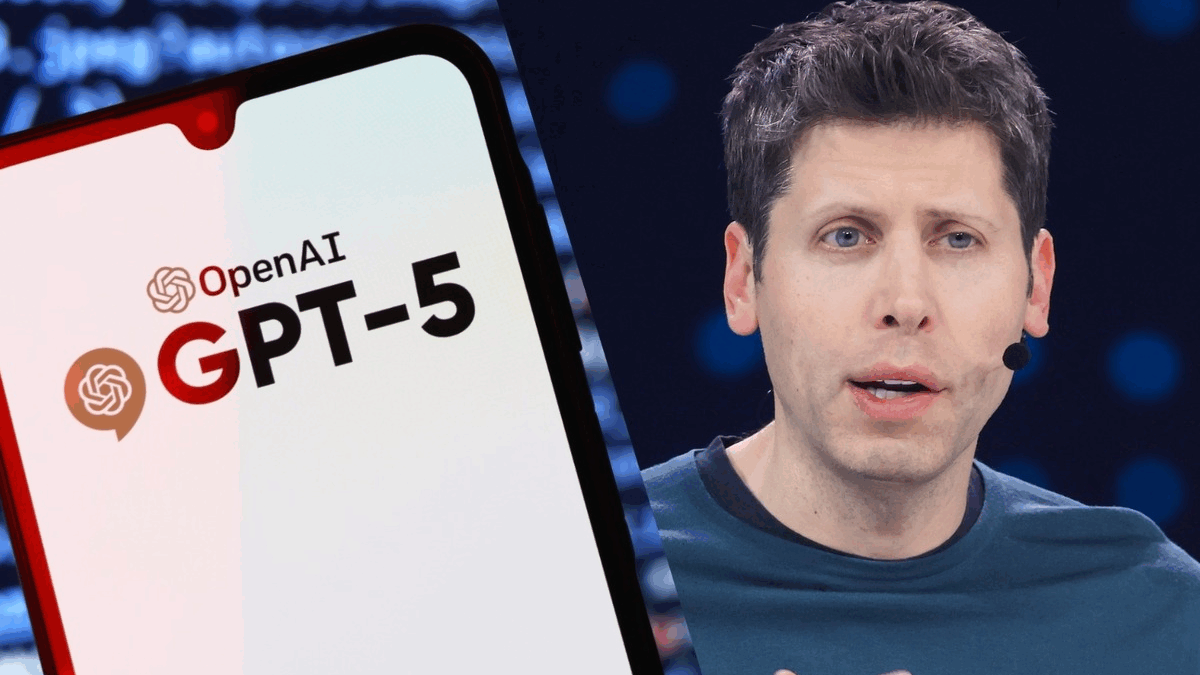

El CEO de OpenAI, Sam Altman, advierte que las conversaciones con ChatGPT no están protegidas por secreto profesional. Descubrí qué implica esto para la privacidad de los usuarios y cómo afecta al uso de la inteligencia artificial.

¿Es privado hablar con ChatGPT? Sam Altman responde

Sam Altman, CEO de OpenAI, ha generado polémica tras una reciente declaración en la que afirmó que las conversaciones con ChatGPT no están protegidas por secreto profesional. Esta advertencia pone el foco sobre la privacidad de los datos compartidos a través de herramientas de inteligencia artificial (IA), especialmente en contextos sensibles como la salud, la psicología, el derecho o las finanzas.

¿Qué significa que no haya secreto profesional en ChatGPT?

Durante una entrevista, Altman fue claro: si bien ChatGPT puede resultar útil para asistir a profesionales o resolver dudas personales, no garantiza la confidencialidad total de la información compartida. A diferencia de una consulta médica, psicológica o legal, las conversaciones con modelos de IA como ChatGPT no están resguardadas por leyes de secreto profesional o privacidad clínica.

Esto implica que, aunque OpenAI afirma no utilizar los datos de forma indebida, la información podría ser accedida por empleados de la empresa para entrenar modelos o resolver problemas técnicos, salvo que el usuario utilice configuraciones específicas que desactiven el entrenamiento con sus datos.

OpenAI y el manejo de la privacidad

OpenAI ofrece opciones de configuración para limitar el uso de tus datos con fines de entrenamiento, pero muchos usuarios desconocen estas herramientas. Por defecto, las conversaciones pueden ser utilizadas para seguir mejorando el sistema, lo que abre interrogantes sobre la privacidad y el consentimiento informado.

¿Qué recomienda OpenAI a los usuarios?

Sam Altman fue enfático: «Si alguien tiene una conversación realmente confidencial, no debería tenerla con ChatGPT.» Esta recomendación busca prevenir malentendidos y reforzar el mensaje de que la IA no reemplaza el asesoramiento profesional humano, sobre todo cuando está en juego información sensible.

Conclusión: ¿cómo usar ChatGPT de forma responsable?

El auge de los asistentes virtuales basados en IA trajo consigo muchas ventajas, pero también desafíos. Es fundamental que los usuarios comprendan los límites de estas tecnologías, especialmente en cuanto a privacidad y protección de datos.

Si tu uso de ChatGPT incluye temas confidenciales, desde Faromud Project te recomendamos:

-Consultar con profesionales humanos cuando la situación lo requiera

-No compartir datos personales sensibles

-Configurar adecuadamente la privacidad en tu cuenta de OpenAI.

A medida que la inteligencia artificial gana protagonismo en la vida cotidiana, es clave entender sus límites y riesgos. Herramientas como ChatGPT pueden ser útiles, pero no reemplazan la privacidad y el respaldo legal que ofrecen los profesionales humanos. Estar informados sobre cómo se manejan nuestros datos es esencial para un uso consciente y responsable de la tecnología.

Cómo afecta esto a empresas y creadores de contenido

Empresas, agencias y creadores de contenido: ¿cómo impacta esta advertencia?

El aviso de Sam Altman no solo afecta a usuarios individuales, sino que tiene implicancias directas para empresas, agencias de marketing, community managers, redactores y freelancers que utilizan ChatGPT como asistente de trabajo diario.

Muchos equipos creativos y de marketing digital integran herramientas de IA en sus flujos de trabajo: para redactar copys, generar ideas de contenido, resumir briefings o incluso analizar resultados de campañas. En esos procesos, es común incluir datos sensibles, como información interna de clientes, presupuestos, estrategias o métricas.

Sin embargo, al no existir secreto profesional ni un entorno cifrado por defecto, existe un riesgo potencial de que esos datos sean utilizados para seguir entrenando el modelo, o incluso, accedidos por personal autorizado de OpenAI en tareas de revisión.

Por eso, es fundamental que las empresas y creadores de contenido:

- Eviten compartir información confidencial dentro de la herramienta.

- Usen versiones empresariales o con configuraciones avanzadas de privacidad si es necesario.

- Tomen decisiones informadas sobre qué tareas automatizar y cuáles seguir manejando en entornos protegidos.

Además, este debate vuelve a poner sobre la mesa la necesidad de formar equipos capacitados en el uso ético y responsable de la inteligencia artificial, tanto para proteger los datos como para mantener la calidad y originalidad del contenido.

Referencias:

Lee más:

Autor: Ivana Minafaro ![]()